Deepfakes são conteúdos digitais gerados ou manipulados por inteligência artificial (IA) e técnicas de deep learning (aprendizado profundo). Eles podem produzir imagens, vídeos e áudios altamente convincentes sobre pessoas ou acontecimentos que, na prática, nunca ocorreram.

Esse tipo de manipulação se tornou uma forma sofisticada de distorção da realidade no ecossistema digital, com uso tanto em contextos criativos quanto em cenários de fraude, desinformação e golpes.

- Tema: IA e prova digital

- Foco: detecção e cautela

- Recorte: implicações jurídicas

O que são deepfakes e por que o assunto ganhou urgência

O termo “deepfake” combina “deep learning” e “fake”. Na prática, descreve a criação ou alteração de mídias por algoritmos que “aprendem” padrões de rosto e voz e conseguem recombiná-los para fabricar um conteúdo falso, mas visualmente plausível.

A preocupação cresce porque, em muitos casos, analisar apenas o contexto ou a qualidade visual não basta. Um material convincente pode circular fora do contexto original, ser repostado com cortes ou ser comprimido — e isso pode camuflar indícios de manipulação.

Deepfakes podem ser usados para atacar reputações, viabilizar fraudes documentais, alimentar extorsões e interferir em processos de comunicação com impactos sociais e econômicos. Por isso, a detecção deixa de ser um tema “técnico” e passa a ser uma habilidade essencial para profissionais e usuários comuns.

Como a tecnologia consegue “parecer real”

Do ponto de vista técnico, deepfakes são gerados por algoritmos de IA que identificam padrões em imagens e áudios reais. Ao reconhecer características do rosto e da voz de uma pessoa, o sistema pode produzir uma versão sintética que imita traços, movimentos e entonações.

A manipulação pode ocorrer de diferentes formas: troca de rostos, clonagem de vozes ou alteração completa de cenas em vídeos e imagens estáticas. O resultado é um material que, a olho nu, pode parecer autêntico — mesmo quando não é.

Entenda o termo “deep learning” sem complicação

Deep learning é uma abordagem de IA em que modelos “aprendem” padrões a partir de muitos exemplos. Em vez de seguir regras fixas, a tecnologia identifica relações e repetições no material (por exemplo, traços do rosto e variações da voz) e usa isso para gerar novas versões que imitam o original.

Sinais visuais e comportamentais que ajudam a desconfiar

Especialistas em detecção de mídias digitais recomendam observar indícios recorrentes. Em geral, o segredo é procurar “pequenos erros” que destoam do comportamento natural de imagens e vídeos.

-

Assimetrias faciais e “mudanças” de traços entre quadros do vídeo.

-

Textura/coloração da pele inconsistentes, com aparência plastificada, manchas ou transições abruptas.

-

Falhas em contornos (cabelo, orelhas, queixo) e bordas “tremidas” em movimento.

-

Sombras incoerentes com a luz do ambiente ou com objetos ao redor.

-

Movimentos labiais que não correspondem à fala e “descolamento” do áudio.

-

Artefatos irregulares (borrões, distorções localizadas) que aparecem e desaparecem.

Atenção: a ausência de “defeitos óbvios” não garante autenticidade. Conteúdos podem ser recortados, comprimidos e reenviados — e isso pode esconder sinais que, em uma análise original, ficariam mais visíveis.

Ferramentas e métodos avançados de detecção

Além da análise visual, há abordagens técnicas mais sofisticadas. Ferramentas de detecção costumam combinar múltiplas técnicas forenses e algoritmos para encontrar sinais sutis de manipulação.

-

Visão computacional para reconhecer padrões e “assinaturas” de síntese.

-

Metadados quando disponíveis, para checar consistências do arquivo e do histórico de edição.

-

Iluminação e sombras para localizar incoerências físicas difíceis de justificar.

-

Padrões biológicos em vídeo, incluindo sinais sutis usados em análises forenses, como indicadores associados ao fluxo sanguíneo detectado em imagens.

Em geral, os melhores resultados aparecem quando a verificação técnica é somada à checagem de contexto e procedência do material.

O que são “metadados” (e por que eles nem sempre ajudam)

Metadados são informações associadas a um arquivo (por exemplo, detalhes de criação, exportação ou edição). Em alguns cenários, eles ajudam a mapear a cadeia de manipulação. Em outros, podem estar ausentes, alterados ou ser removidos quando o arquivo é reenviado por aplicativos e redes sociais.

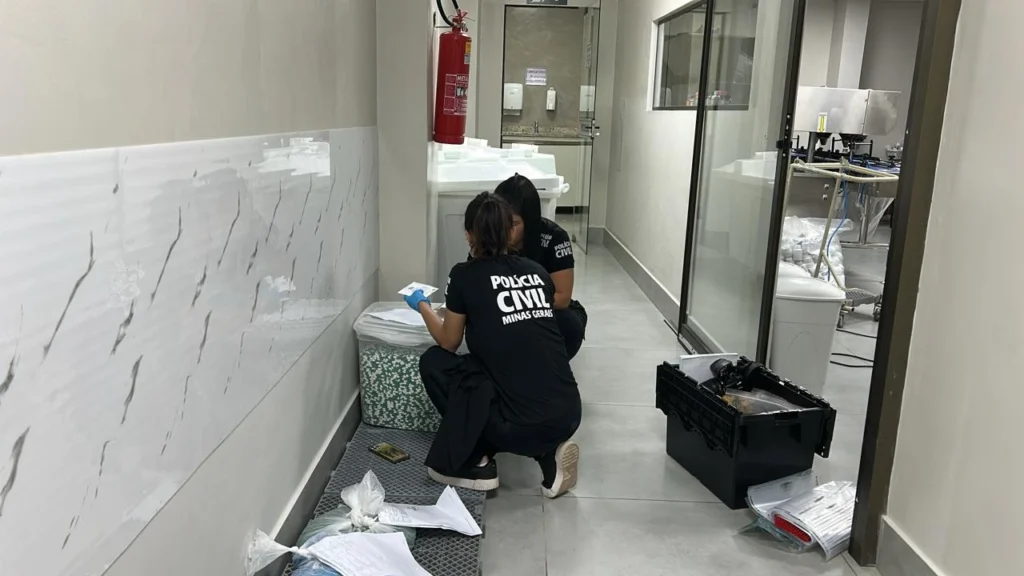

O olhar do Direito: prova, responsabilização e danos

No campo jurídico, reconhecer e responder à circulação de deepfakes envolve desafios relevantes: rastrear autoria, demonstrar manipulação com prova técnica e agir com rapidez para mitigar danos — especialmente quando há violação de direitos da personalidade, fraude ou dano reputacional.

No Brasil, o texto-base indica que ainda não existe uma legislação específica e ampla sobre produção e difusão de conteúdos manipulados por IA. Mesmo assim, podem ser acionados instrumentos ligados à proteção de dados e ao enfrentamento da desinformação, conforme o caso concreto.

-

Prova: transformar suspeitas em elementos técnicos confiáveis (por exemplo, perícia e análise forense).

-

Danos: reputação e imagem podem ser afetadas de modo rápido e de difícil reparação.

-

Urgência: velocidade de circulação pode exigir medidas rápidas para reduzir o alcance.

O que fazer ao se deparar com um conteúdo suspeito

Para usuários comuns e profissionais, a recomendação mais segura é combinar cautela com verificação. A ideia não é “virar perito”, mas adotar uma rotina mínima que reduza o risco de compartilhar manipulações convincentes.

-

Não compartilhe no impulso: urgência e pressão emocional costumam ser sinais de risco.

-

Procure inconsistências: rosto, pele, contornos, sombras e sincronização labial.

-

Cheque contexto: o material vem com fonte verificável? há recortes que mudam sentido?

-

Quando necessário, use ferramentas: técnicas de detecção combinam análise visual e forense.

Interativo: teste rápido de suspeita

Marque a opção que melhor reflete a ideia central do texto sobre detecção de deepfakes:

1) Para identificar deepfakes, basta avaliar a qualidade visual e confiar no contexto em que o vídeo foi enviado?

2) Quais exemplos aparecem como indícios comuns em deepfakes, segundo o texto?

Por que a detecção virou um “imperativo” no ambiente digital

Com a evolução das técnicas de IA e a maior acessibilidade à geração de conteúdo sintético, cresce a necessidade de avaliação crítica. Isso vale tanto para profissionais jurídicos quanto para usuários comuns: a preservação da confiança em mídias digitais depende de práticas de verificação e de respostas institucionais consistentes.

Em termos institucionais, o texto também aponta investimentos de empresas de tecnologia, agências de verificação e órgãos reguladores em sistemas automáticos e parcerias com pesquisadores — incluindo rotulagem e autenticação de mídias em plataformas digitais.

Glossário rápido (termos citados no texto)

-

IA (Inteligência Artificial): técnicas que permitem a sistemas realizar tarefas que simulam capacidades humanas (como reconhecer padrões e gerar conteúdo).

-

Deep learning: tipo de IA que aprende padrões a partir de muitos exemplos, útil para síntese de imagem e voz.

-

Metadados: informações associadas a um arquivo que podem ajudar a entender origem e edições (quando disponíveis).

-

Forense digital: conjunto de técnicas para analisar evidências digitais e identificar manipulações ou inconsistências.

Fonte: https://surl.li/lyesum